当你在短视频平台打开滤镜,戴上一副虚拟墨镜,或者瞬间变成卡通人物时,你可能很少去思考一个问题:为什么这些面具特效可以如此精准地贴合你的脸?即使你转头、眨眼甚至大笑,它们依然“稳稳地挂”在脸上。

事实上,这背后并不是简单的图像叠加,而是一整套复杂的实时视觉计算技术。而支撑这些体验的核心能力,正是如今被广泛应用在直播、短视频、社交、AR互动等领域的——美颜SDK。

今天,我们就来拆解一下:面具特效是如何做到实时贴合的?

一、面具特效的核心:人脸识别与关键点定位

想让一个面具精准贴在脸上,系统首先必须“看懂”一张脸。

这一步依赖的是人脸检测(Face Detection)和人脸关键点定位(Face Landmark)技术。

简单来说,算法需要在摄像头画面中完成三件事:

识别出哪里是人脸

标记脸部关键位置

计算面部结构与姿态

通常,一套成熟的美颜SDK会识别68—468个面部关键点,例如:

· 眼睛位置

· 鼻梁位置

· 嘴巴轮廓

· 下巴曲线

· 眉毛位置

通过这些关键点,系统就能构建出一个动态的人脸模型。

这就像在脸上打了一层隐形“骨架”,所有特效都会依附在这个骨架上。

例如:

· 猫耳朵贴在头顶关键点

· 墨镜跟随眼睛关键点

· 面具包裹整个脸部轮廓

当用户转头或移动时,关键点位置会实时更新,从而实现特效同步移动。

二、实时追踪:为什么特效不会“掉下来”

很多人会疑惑:为什么面具特效在移动时不会漂移?

关键就在于人脸追踪(Face Tracking)技术。

系统会在每一帧画面中持续计算:

· 人脸角度(Pitch / Yaw / Roll)

· 头部旋转

· 表情变化

· 面部位移

通过这些数据,特效可以进行实时3D空间计算。

举个简单例子:

当用户向左转头时,系统会同步计算出头部旋转角度,然后让虚拟面具按照相同角度旋转。

因此看起来就像真的戴在脸上一样。

优秀的美颜SDK通常可以做到:

· 毫秒级追踪

· 低延迟渲染

· 高稳定性贴合

例如像一些专业级解决方案(如美狐美颜SDK),在算法优化和性能控制上会特别强调:

· 低功耗运行

· 高帧率实时追踪

·多人脸识别

这也是为什么很多直播、短视频、社交APP在接入SDK之后,依然可以保持流畅体验。

三、表情驱动:让特效“活”起来

如果只是贴一张图片,那其实很容易。

真正的难点在于——表情驱动(Expression Tracking)。

当用户:

· 张嘴

· 眨眼

· 微笑

· 嘟嘴

系统需要捕捉这些细微变化,并驱动特效同步变化。

例如:

· 张嘴 → 虚拟面具也张嘴

· 眨眼 → 卡通角色同步眨眼

· 微笑 → 表情贴纸跟着变化

这背后的技术通常涉及:

· 面部肌肉运动识别

· 关键点动态变化分析

· 表情驱动动画系统

通过这些技术,特效就不再是“贴图”,而变成了可互动的AR角色。

四、实时渲染:手机为什么还能这么流畅?

还有一个关键问题:手机算力有限,为什么还能实时运行这么多特效?答案是:算法优化 + GPU渲染加速。

成熟的美颜SDK通常会通过以下方式提升性能:

1 算法轻量化

通过深度学习模型压缩,让AI模型更小、更快。

2 GPU加速渲染

利用手机GPU进行图像处理,而不是完全依赖CPU。

3 分层渲染

将:

· 美颜

· 滤镜

· 面具

· 特效动画

拆分成不同渲染层,提高效率。

美颜SDK这类专业方案,通常会针对:

· Android

· iOS

进行专门优化,从而保证直播与短视频场景的稳定体验。

五、为什么越来越多APP接入美颜SDK?

随着短视频、直播、社交娱乐的爆发,用户对视觉体验的要求越来越高。

现在的用户不仅希望:

· 皮肤更细腻

· 画面更清晰

还希望拥有:

· 个性化滤镜

· 趣味面具

· AR互动特效

而自研这一整套技术成本非常高,因此越来越多开发者选择直接接入成熟的SDK解决方案。

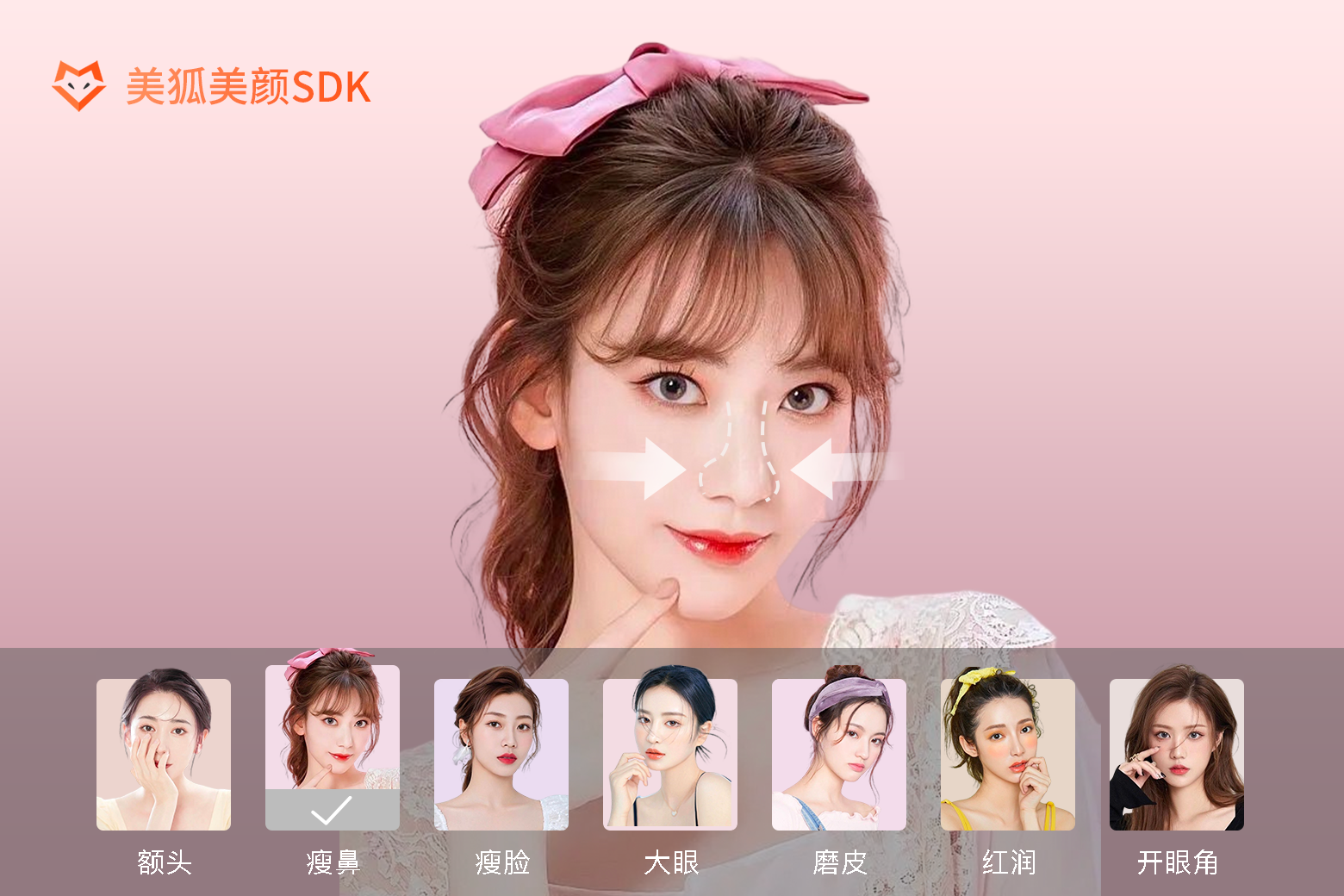

美狐美颜SDK通常会提供:

· 美颜美型

· 面具特效

· 滤镜系统

· 贴纸动画

· 实时渲染优化

开发者只需要几行代码接入,就能快速实现完整的视觉特效能力,大大降低开发周期。

结语:

从用户视角来看,面具特效只是一个有趣的小功能。

但从技术角度来看,它其实融合了:

· 人脸识别

· 关键点定位

· 表情识别

· 实时追踪

· GPU渲染

等多项计算机视觉技术。

也正是因为这些技术的成熟,我们才能在短视频和直播中体验到如此自然、有趣的互动特效。而随着AI视觉技术不断进步,未来的美颜与AR特效体验,还会更加真实与智能。

对于开发者来说,选择一套成熟稳定的美狐美颜SDK,可以更快地打造出具备竞争力的视觉互动产品。

声明:本文由美狐原创,未经允许禁止转载,谢谢合作。

您当前的位置:

您当前的位置: